生物やその営みメカニズムを情報処理による問題解決に応用する試みが学べます。第二次AIブームの後に出版された本ですが既にディープラーニングと同じような考えが記述されています。第三次AIブーム前夜といったところでしょうか。

ニュース

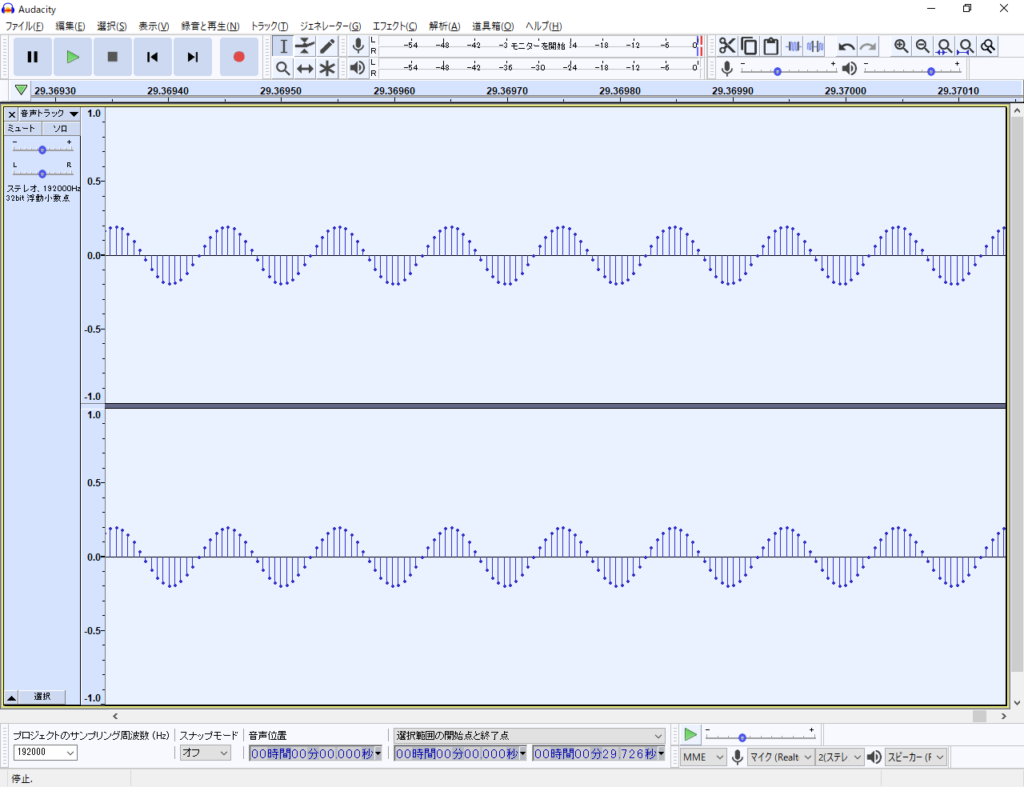

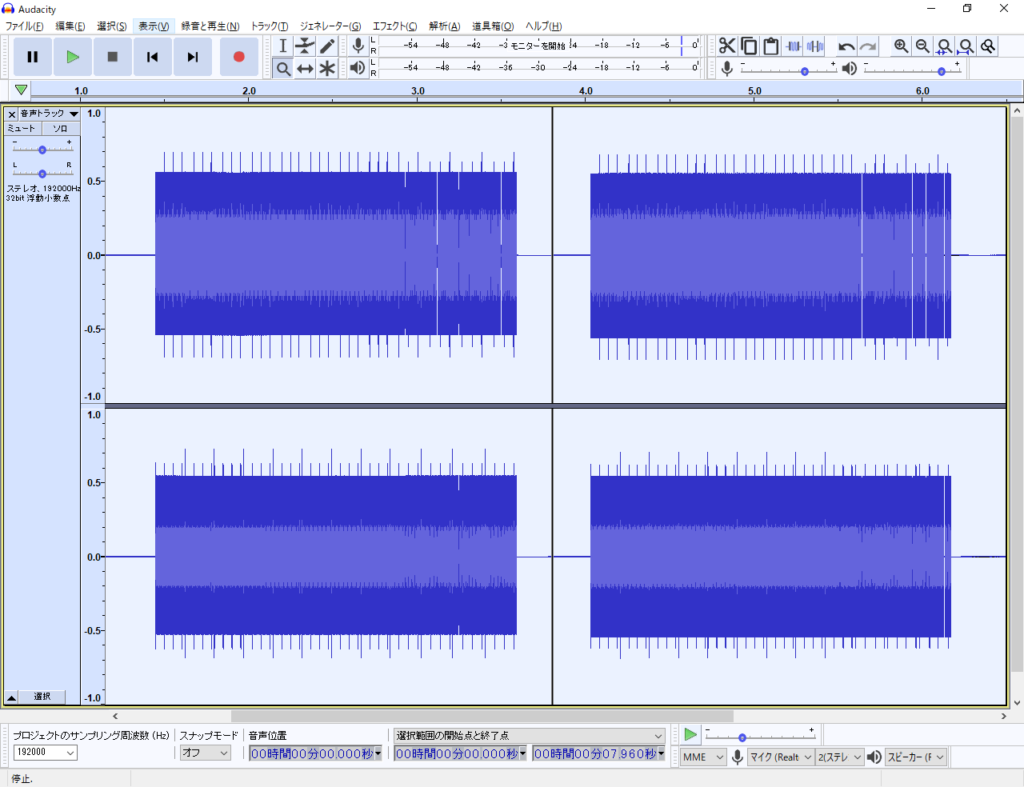

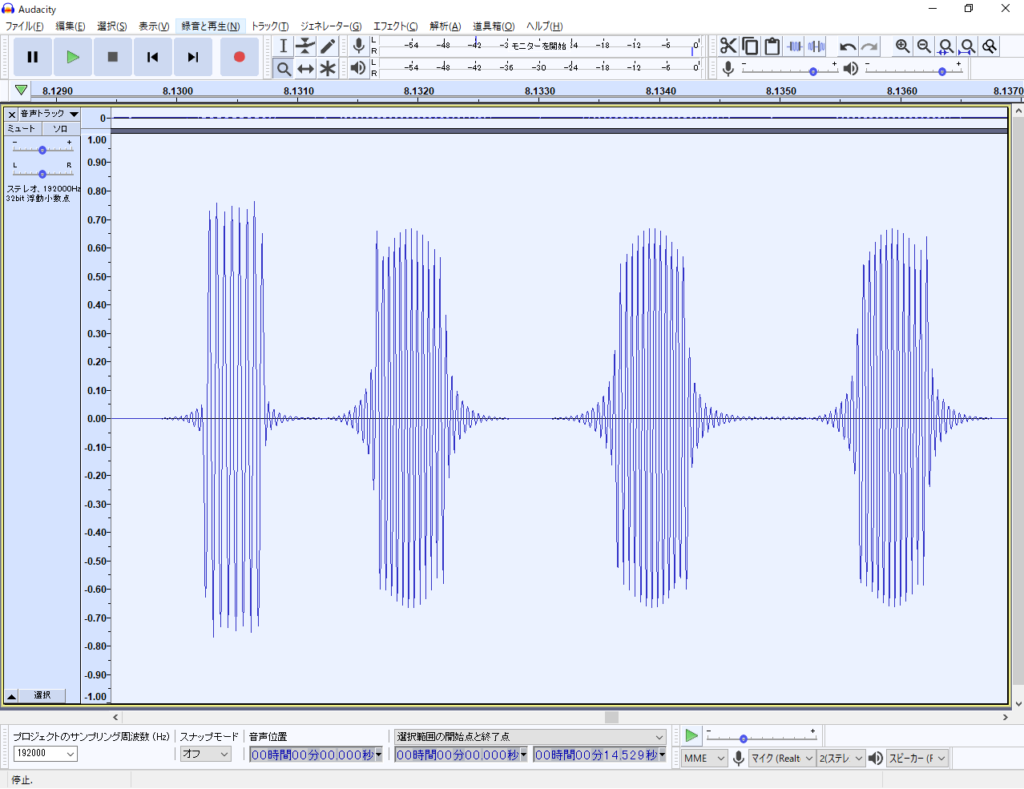

Audacityで波形を表示できるようになったのですが電圧をどう読み取ったら良いかが解りませんでした。オシロスコープの代わりにしようとしているので波形と電圧について調べました。

初めにテスターで測りやすいように正弦波を出力するプログラムを作成しました。

#include <iostream>

#include <windows.h>

#include <math.h>

#include <MMSystem.h>

#pragma comment (lib, "winmm.lib")

constexpr auto SAMPLING = 192000;

constexpr auto CHANNEL = 2;

constexpr auto BITSPERSAMPLE = 16;

constexpr auto MAXAMP = 32767;

int main() {

LPWORD lpWave;

WAVEHDR whdr;

WAVEFORMATEX wfe;

HWAVEOUT hWaveOut;

wfe.wFormatTag = WAVE_FORMAT_PCM;

wfe.nChannels = CHANNEL;

wfe.wBitsPerSample = BITSPERSAMPLE;

wfe.nBlockAlign = CHANNEL * BITSPERSAMPLE / 8;

wfe.nSamplesPerSec = SAMPLING;

wfe.nAvgBytesPerSec = wfe.nSamplesPerSec * wfe.nBlockAlign;

size_t frequency;

DWORD dataLength;

DWORD wavelength;

DWORD i;

std::string str;

std::cout << "周波数を入力しEnterで開始します。" << std::endl;

std::cin >> str;

frequency = std::atoi(str.c_str());

wavelength = (DWORD)SAMPLING / (DWORD)frequency;

dataLength = (DWORD)((size_t)CHANNEL * (BITSPERSAMPLE / 8) * wavelength);

lpWave = (LPWORD)calloc(sizeof(WORD), dataLength);

for (i = 0; i < wavelength; i++) {

lpWave[i * 2] = (WORD)(MAXAMP * sin((i * 6.28318530718) / wavelength));

lpWave[i * 2 + 1] = (WORD)(MAXAMP * sin((i * 6.28318530718) / wavelength));

}

whdr.dwBufferLength = dataLength;

whdr.lpData = (LPSTR)lpWave;

whdr.dwFlags = WHDR_BEGINLOOP | WHDR_ENDLOOP;

whdr.dwLoops = UINT32_MAX;

waveOutOpen(&hWaveOut, 0, &wfe, 0, 0, CALLBACK_NULL);

waveOutPrepareHeader(hWaveOut, &whdr, sizeof(WAVEHDR));

waveOutWrite(hWaveOut, &whdr, sizeof(WAVEHDR));

std::cout << "何か入力しEnterで終了します。" << std::endl;

std::cin >> str;

waveOutReset(hWaveOut);

waveOutClose(hWaveOut);

free(lpWave);

}

このプログラムは入力した周波数の正弦波を左右最大の値で音声出力します。

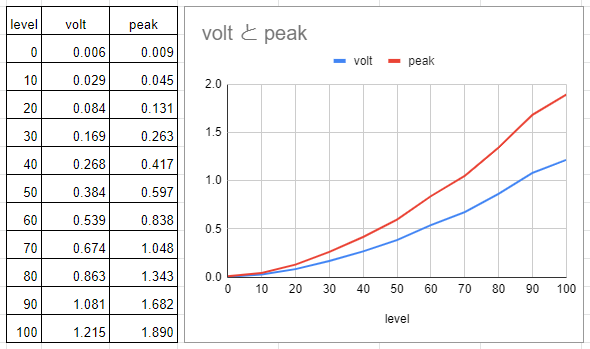

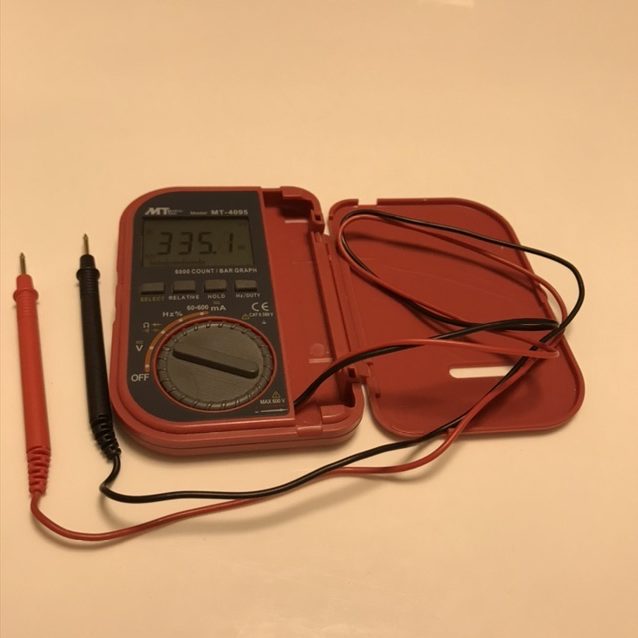

音量0から10刻みで100まで増やした時の交流電圧です。ピークの算出は√2×1.1をテスターで測った交流電圧値にかけています。使ったテスターの値は多分平均値出力と思いましたので。

音声出力レベル70でピークが±1Vになるようです。

出力側それぞれに4.7KΩの抵抗を並列にして約2.3KΩにしたものを入れて出力値を調整します。

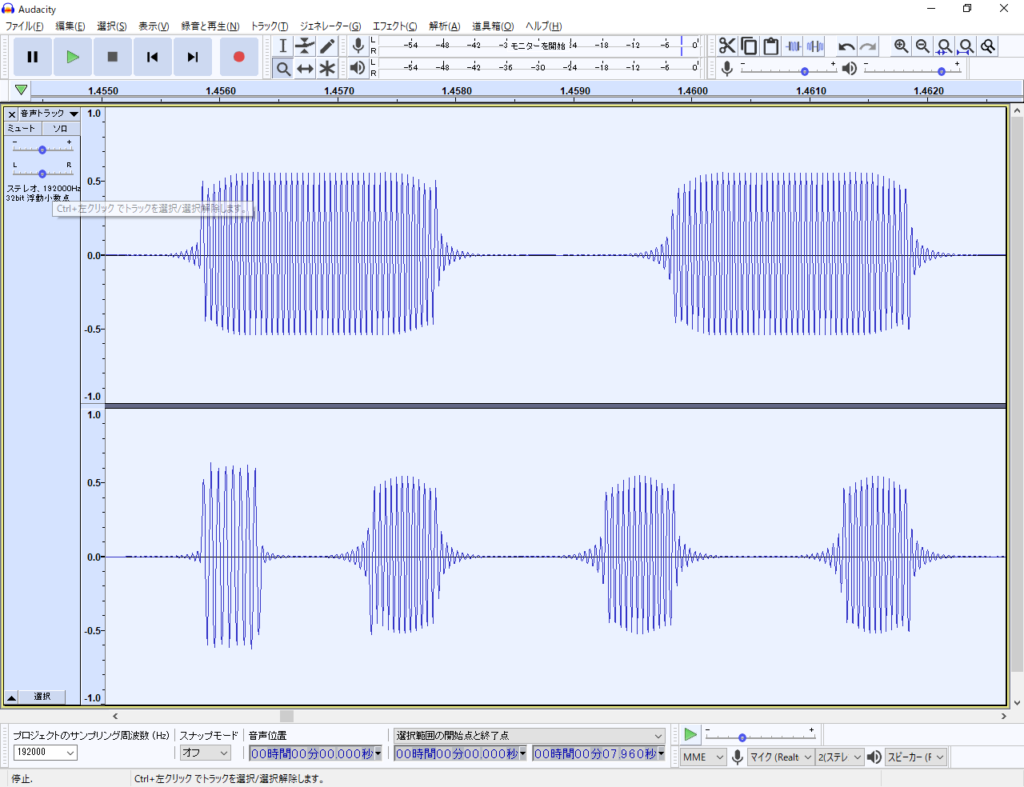

マイクレベル18でピーク±1Vの正弦波をAudacityで表示しました。右側の目盛0.1で1V表示になります。

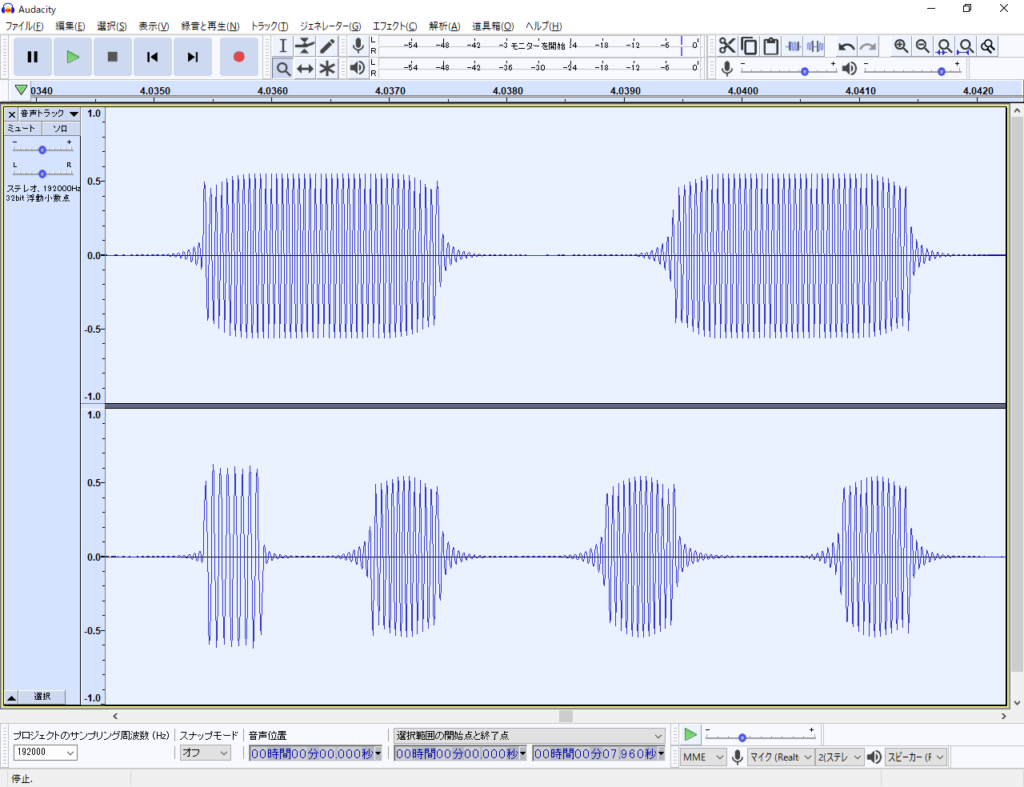

マイクレベル38でピーク±1Vの正弦波をAudacityで表示しました。右側の目盛0.2で1V表示になります。

可聴範囲に限定ですがデジタルストレージオシロスコープが出来ました。

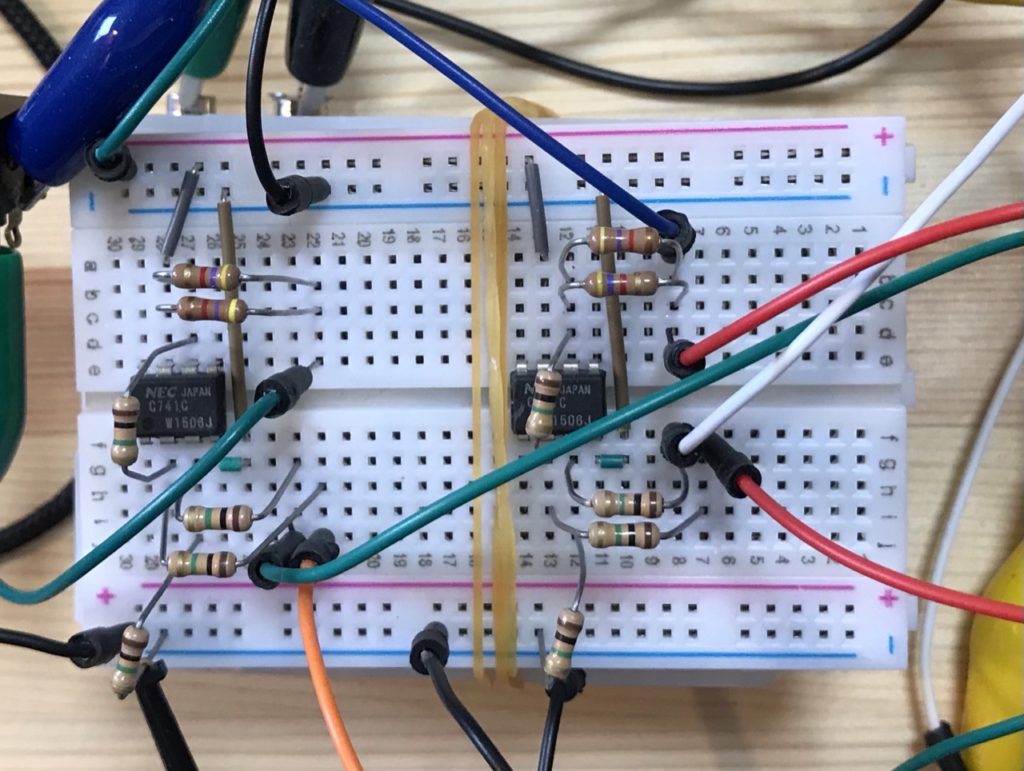

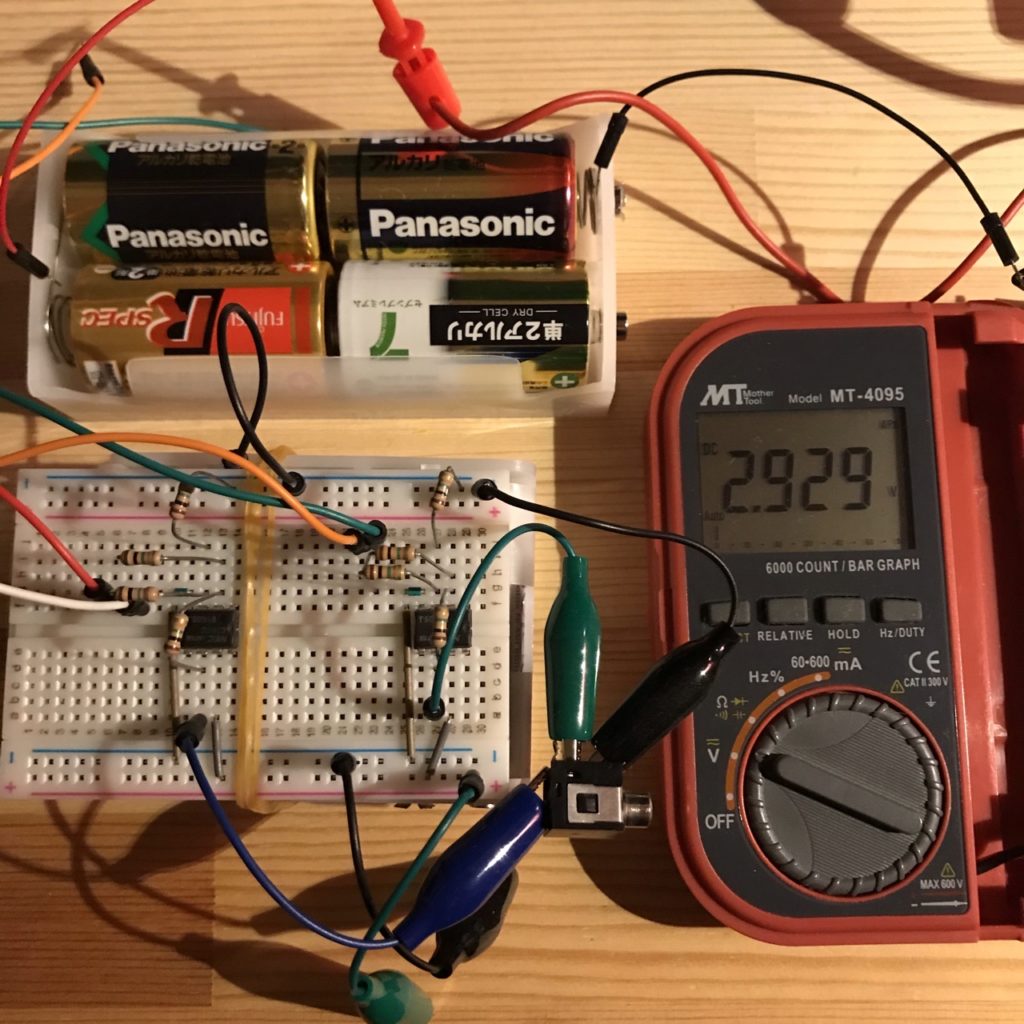

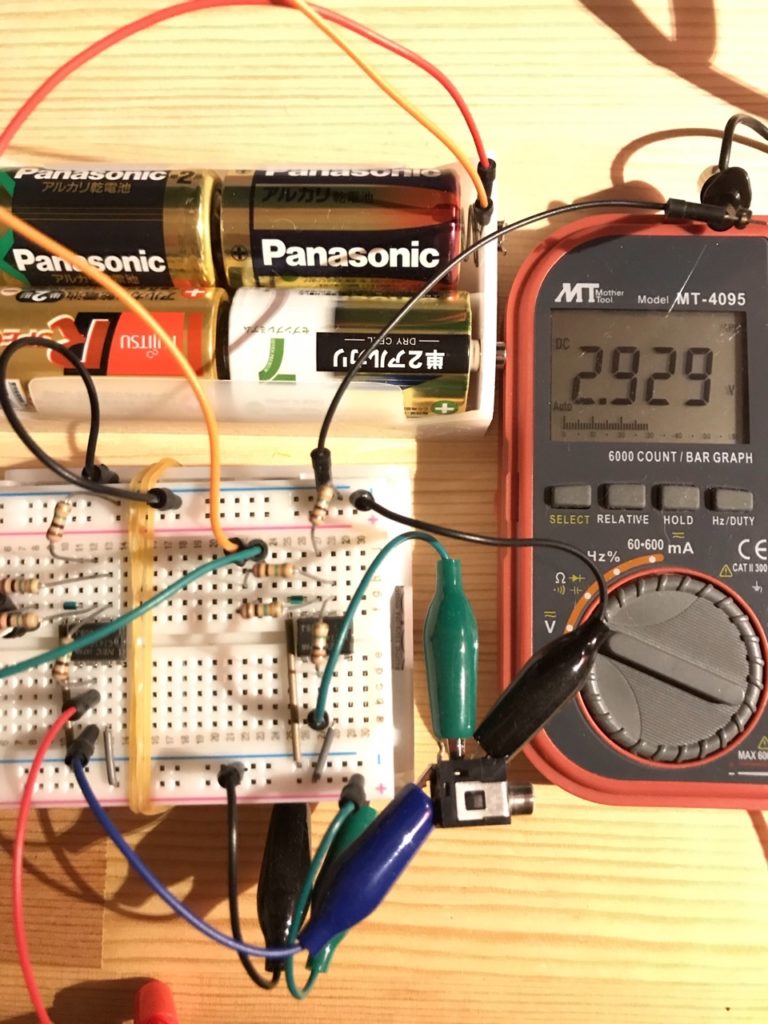

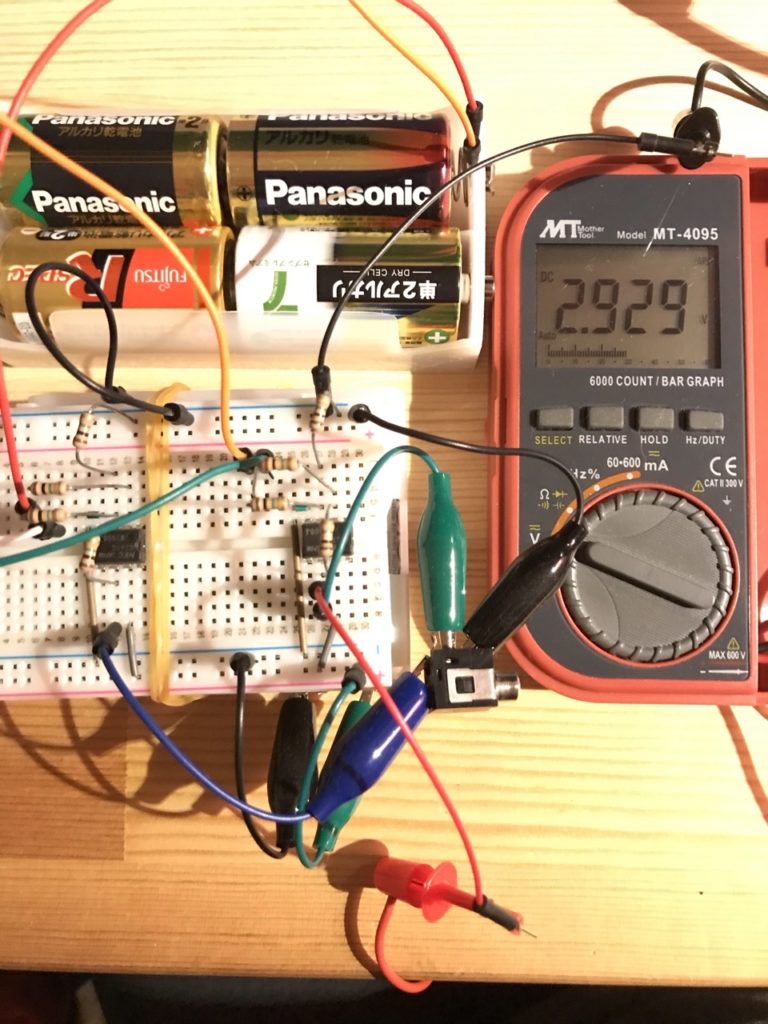

オペアンプで作った差動増幅器をステレオにし入出力の電圧差が少なくなるように調整しました。

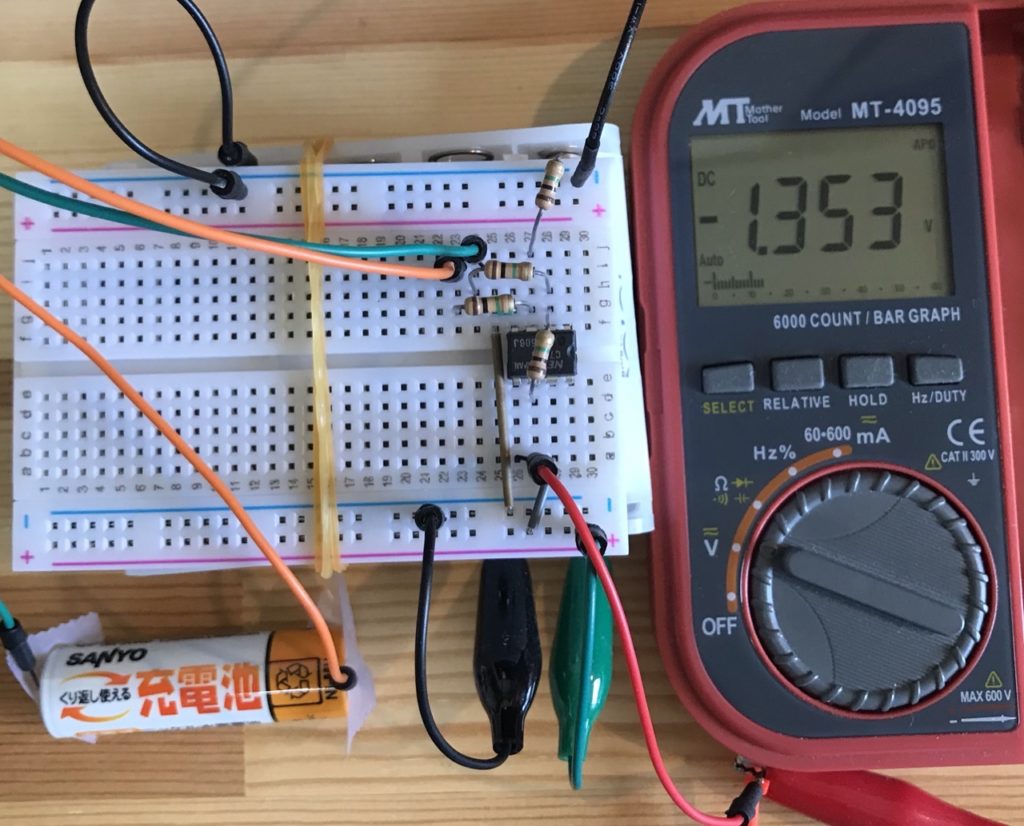

乾電池2本分を入力電圧とします。

手持ちの抵抗を色々取り替えて入出力電圧が同じになるように調整しました。

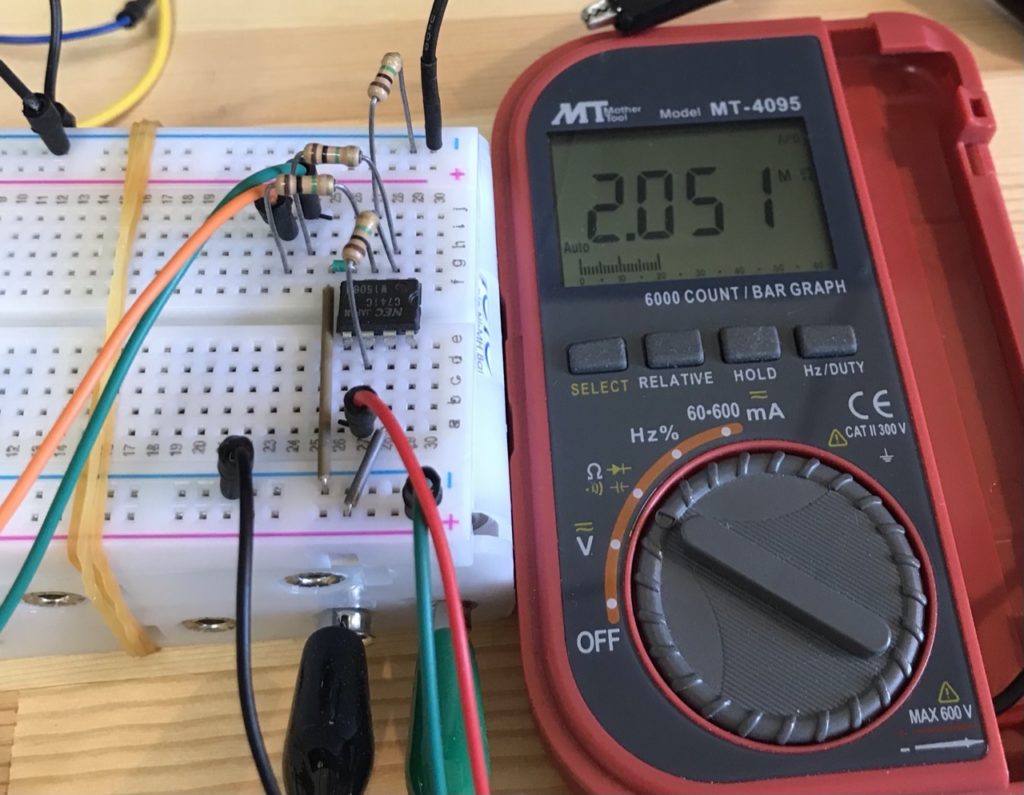

もう一つのチャンネルも抵抗を取り替えて入出力電圧が同じになるように調整しました。普通のカーボン抵抗でも誤差同士のバランスが合えばそこそこの精度が得られます。安定性には疑問がありますがデジタル信号であればまあいけると思います。

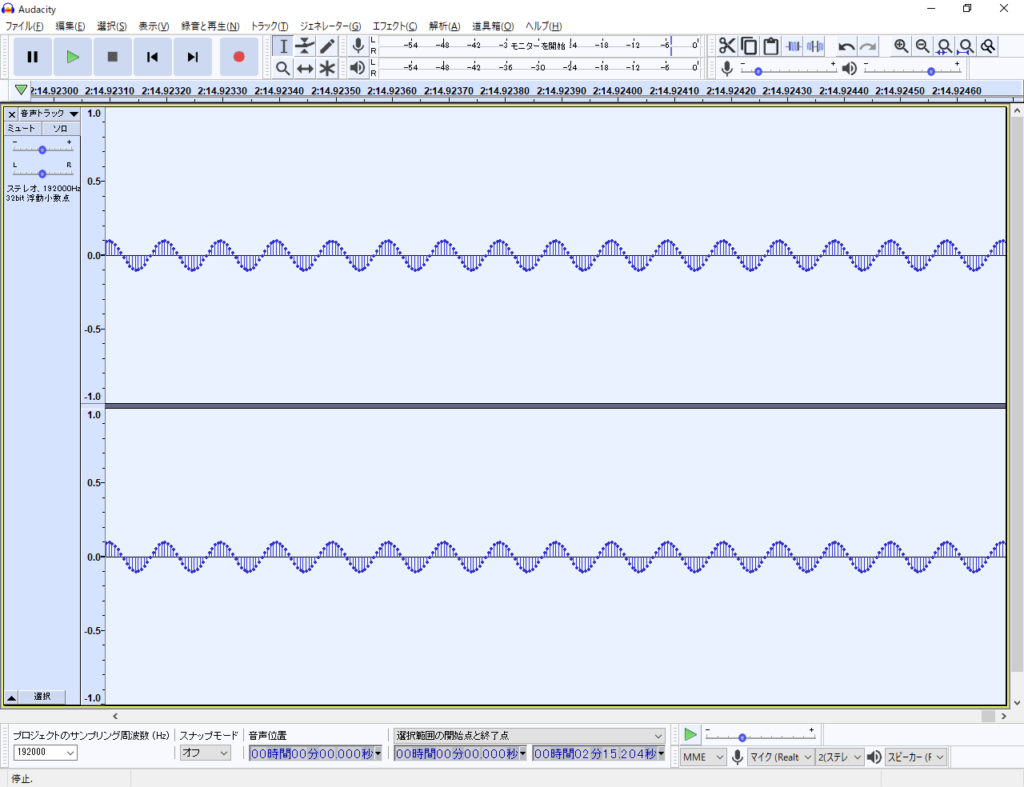

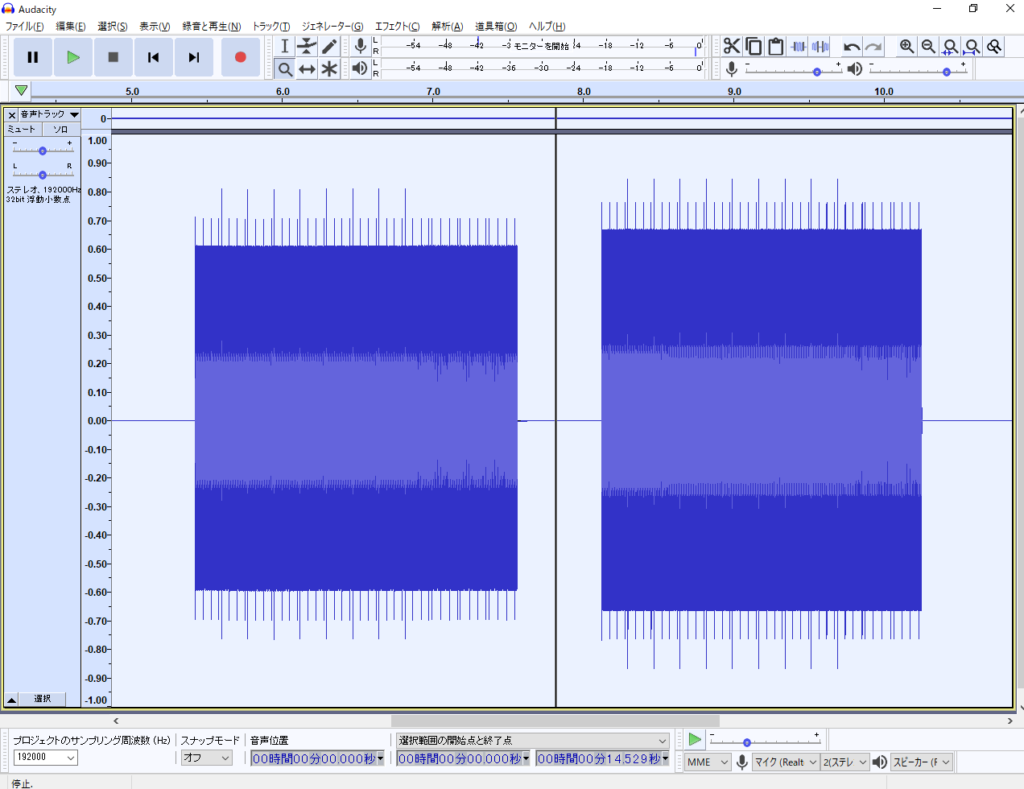

では実際に信号を入れて結果をAudacityで観察します。右が入力信号、左が出力信号です。出力レベル80、入力レベル67でほぼ入力と出力のレベルが同じになりました。

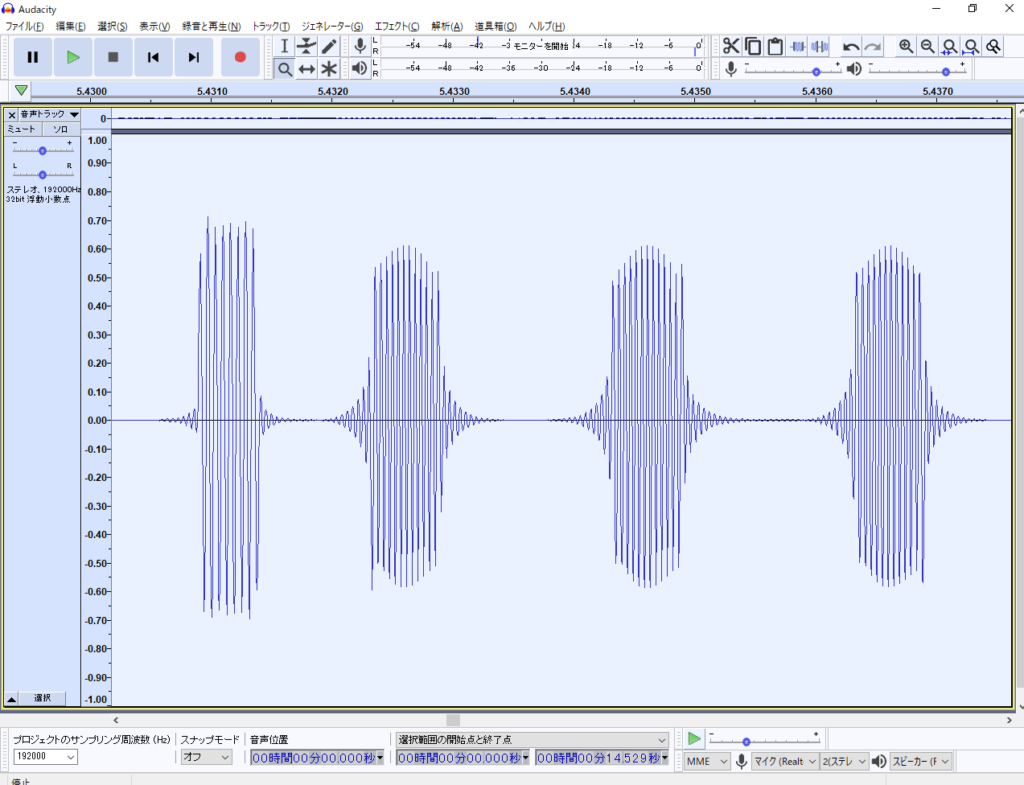

入力信号を拡大した様子です。

出力信号を拡大した様子です。入力の極を入れ替えて反転を無くしほぼ入出力同じにできました。オシロスコープを買わなくても波形が確認できそうです。測定器を買うのではなく用途に合わせて簡易でも作ることができれば勉強にもなり経済的かつ達成感を味わえます。更に問題が起きても解決の糸口を見つけやすくなります。

なぜ8ビットマイコンを今更取り上げてAIを作ろうとしているかの経緯を話します。

元々AIには興味を持っていたのですがGPUによる高速演算とテンソンフローの公開により続々と個人ベースで高性能な人工知能システムを完成させている事例を見聞きするにつれ自分もそれに参加したくなったのです。

特にスマホにニューロエンジンと呼ばれる専用ハードウェアが搭載されたことが決定的な出来事でした。

現在スマホのアプリエンジニアとして仕事をしておりいよいよ直ぐそこまでAIが近いてきています。

今後もアプリ開発の現場に留まるためにはAIのスキルも必要と思いました。

西暦2000年前後の頃に汎用ICやPCのグラッフィックボードを使用して低価格で高速計算機を構築する研究結果が出始めその後FPGAを使うなど高性能化が更に進んでいきました。このような背景が第三次AIブームを引き起こした遠因なのでしょう。スーパーコンピュータ並みの計算能力を個人が手に入れることができる時代になったのです。

1995年に完成したGRAPE-4は5Wで243.2GFLOPSを達成したそうです。https://ja.m.wikipedia.org/wiki/濱田剛

個人にとってはその計算機の開発費用もさることながら消費電力も重要な所有の条件です。大容量電力を個人ではとても用意できません。

5Wなら自分でも容易に環境を作ることができます。

マイクロプロセッサでAIを作るにしても具体的にどうするか決めてからではないと行動できません。ネットで「マイコン」と調べても無数に情報があり的を絞ることができません。

第一条件として予算、高価で揃えられないものを夢みても空論で終わってしまうので費用を第一の条件とします。

第二条件として普及度、今この時にしかないような特殊なものは使わないようにします。過去も有ったし未来も有るだろう、それは汎用品だからというものを第二の条件とします。

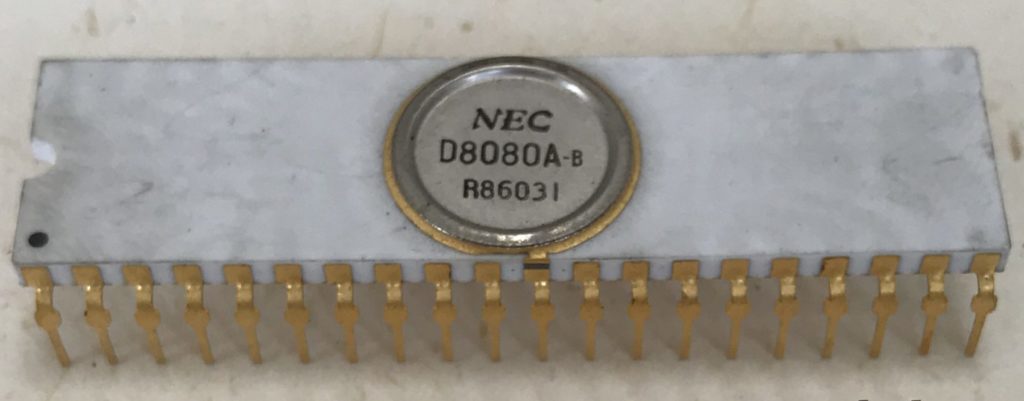

この条件に当てはまると思ったのがIntel系の8ビットCPUです。極めて広範囲に普及した為に情報量が多く数十年間様々な分野で君臨しています。これからも廃れることはないでしょう。

このCPUは割と今でも手に入ります。最新のCPUより割高ですが機能が少なく作りが大きいので素人が学習するには良い教材です。秋月であれば100円以下のCPUもありますが基本から技を得るためにヴィンテージCPUを選択しました。

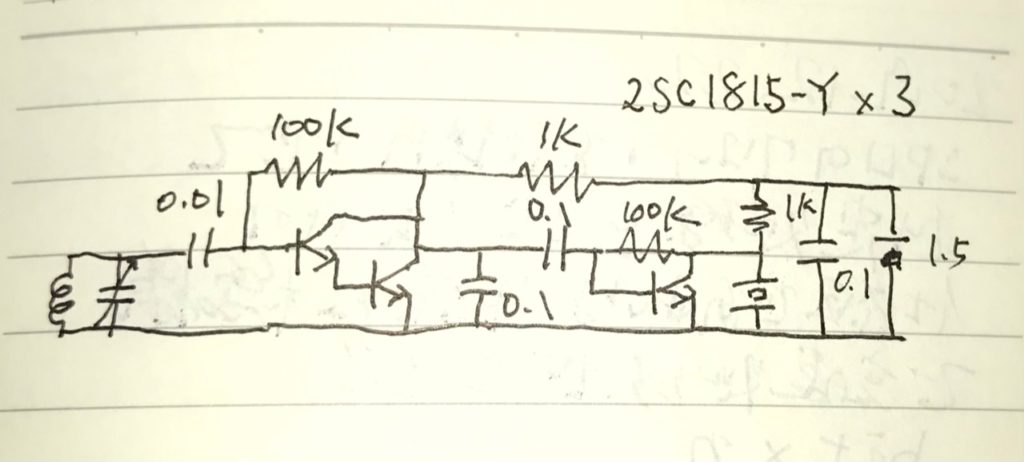

鉄筋コンクリートではゲルマニュームラジオを動かすとができなかったのでトランジスタの力を借ります。

https://www.zea.jp/audio/schematic/sc_file/022.htm

アンテナはベランダに出したビニール線(LANケーブルをばらしたもの)、コイルとバリコンとクリスタルイヤホンはゲルマニュームラジオで使ったもの、ダイオードをやめて高周波増幅に2SC1815を2個ダーリントンにし、低周波増幅も2SC1815を使いました。電源は単3電池2個です。

鳴りました。分離性が悪い為、受信できた放送局は少ないですが確かに鳴りました。円筒型バリコンの内側を引き出せば短波放送も受信できたのです。

実用性がないものですが動くととても楽しいものです。出だし吉と占われたと思いAIが完成するまで頑張ろうと思います。

部品数が十数点の小さな電子回路からの出発ではゴールは見えない遥か彼方です。少しずつ進めていく過程をここで報告致します。

マイクロプロセッサーを使いAIを作ってみようと思いMPUをどうしようかと調べていました。当然最初は今流行りのARMを選択するのが普通です。しかし昨今凋落著しい国産半導体の報道に触れていると、できれば国産がいいなとの思いがつのります。この時点でいかにもグローバル化に乗り遅れている感が出てしまっていて恥ずかしい限りですが言い訳は多々思いつくので良しとします。

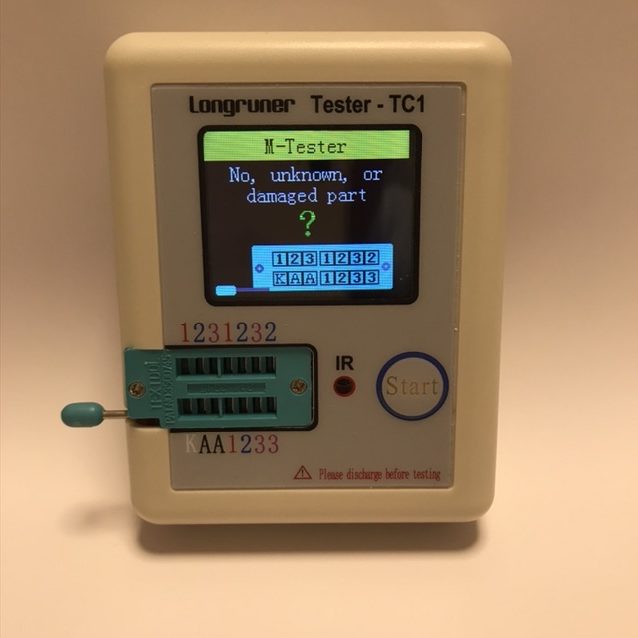

手元には高価では無いデジタルテスター2台とダイソーで買ったハンダゴテしかありません。ヤフオクで色々な機材を揃えるのも大変なので出来るだけ低い周波数の世界でAIを実現することを目標にします。幸いにもMacとWindows PC、iPhoneやらAndroidスマホがあるので結構出来ることは多いと思います。

しばらくぶりに工作するので本番前に練習をしました。幸先を占うためにも何かしら簡単に結果が出るものとしてラジオを作りました。

最も簡単なラジオはゲルマニュウムラジオですが鉄筋コンクリートでは受信できないかもしれません。

コイルはバーアンテナが良く使われますが手持ちも無く買ったとしても他に使い道もないので作ります。自作のアンテナコイルはポリウレタン線やリッツ線で作りますがそれも無いので使わなくなったLANケーブルをバラして厚紙で作ったボックスに巻きつけました。

バリコンはポリバリコンが良く使われますがこれも手持ちがありません。バーアンテナと同じく買ったとしても他に使い道が無いので無駄になってしまいます。

アルミホイルとキッチンペーパーを重ねて丸めます。それを二つ作り片方がもう一方の内側に差し入れることが出来るように若干小さくします。完全に差し込まれている時が2枚のアルミホイル間の静電容量が最大の時で少しづつ抜いていくと静電容量が下がります。立派なバリコンが出来上がります。

ゲルマニュームダイオードとクリスタルイヤホンの自作は100均の材料では無理なので購入しました。

一通り部品が揃ったのでブレッドボードに差し込んでクリスタルイヤホンを耳にしてみましたが雑音すら聞こえませんでした。

予想通りです。

Audacityで波形を表示して自作回路の動作を確認していたのですが、パソコンの音声入力を被計測回路に接続すると動作が変わってしまうので間に挟む装置を作ります。

今まで自作回路の測定点に音声入力端子を直か逆流防止のダイオードを挟んで使用していました。可聴範囲の単純な回路が多かったためそれでも十分でしたが、ROMライターの製作過程でGNDのレベルが異なるようになってから波形とその電圧レベルが知りたくなりました。

オシロスコープを使えばなんのこともないのですが、持っていないので自作することにしました。これも勉強のためです。

表示はパソコンのAudacityでできるので被測定側に影響が出ないように音声入力できれば良いので単純な装置でできると思います。

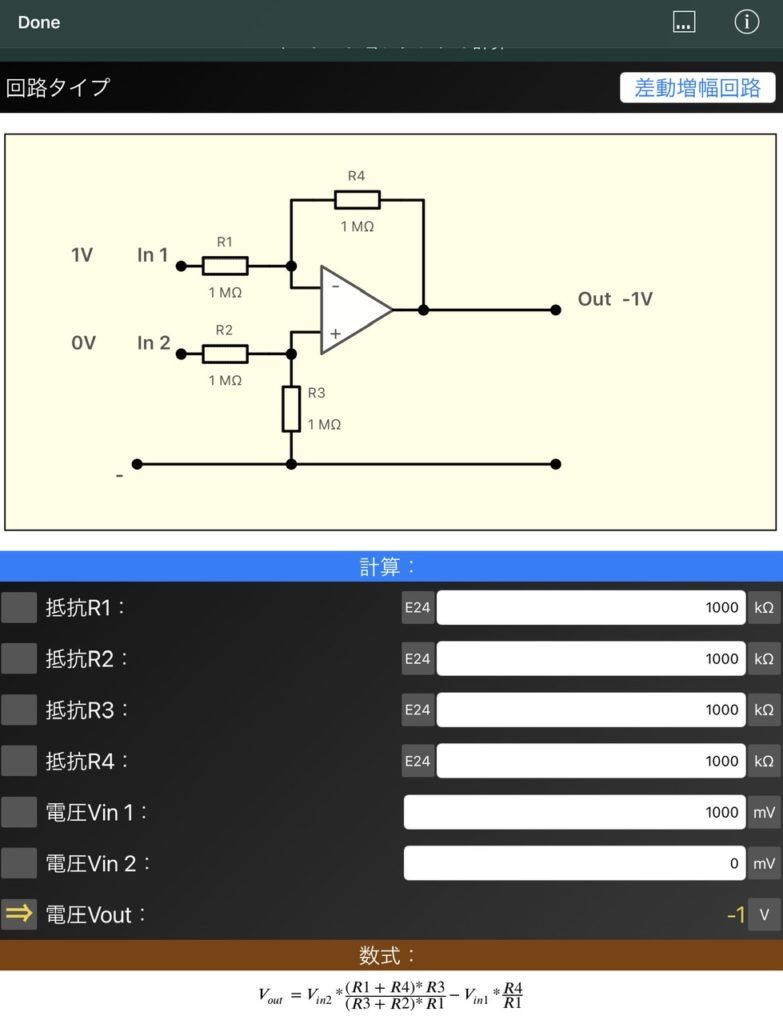

抵抗値高めの差動増幅器です。被測定回路に影響をなるべく与えないように全て1MΩにしました。使用するオペアンプはuPC741Cです。

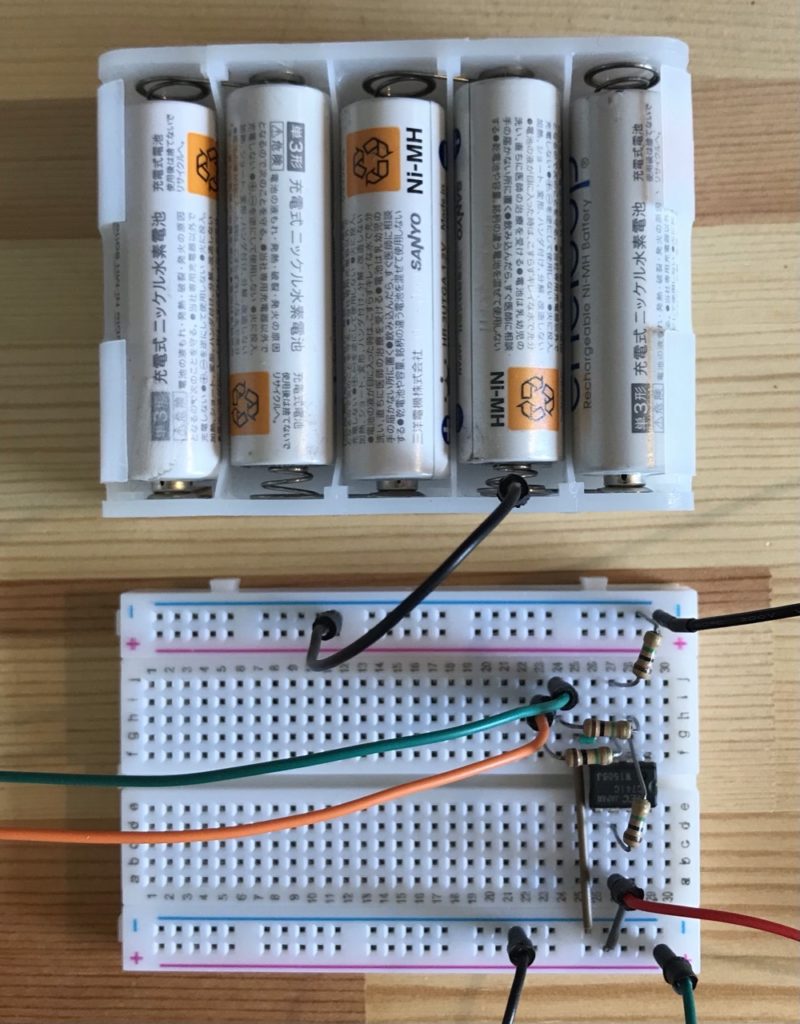

1.3Vの単3電池が直列に10本入る電池ボックスを使い真ん中をGNDにします。被測定回路とは別の電源を使った方がより干渉し合わないと思います。

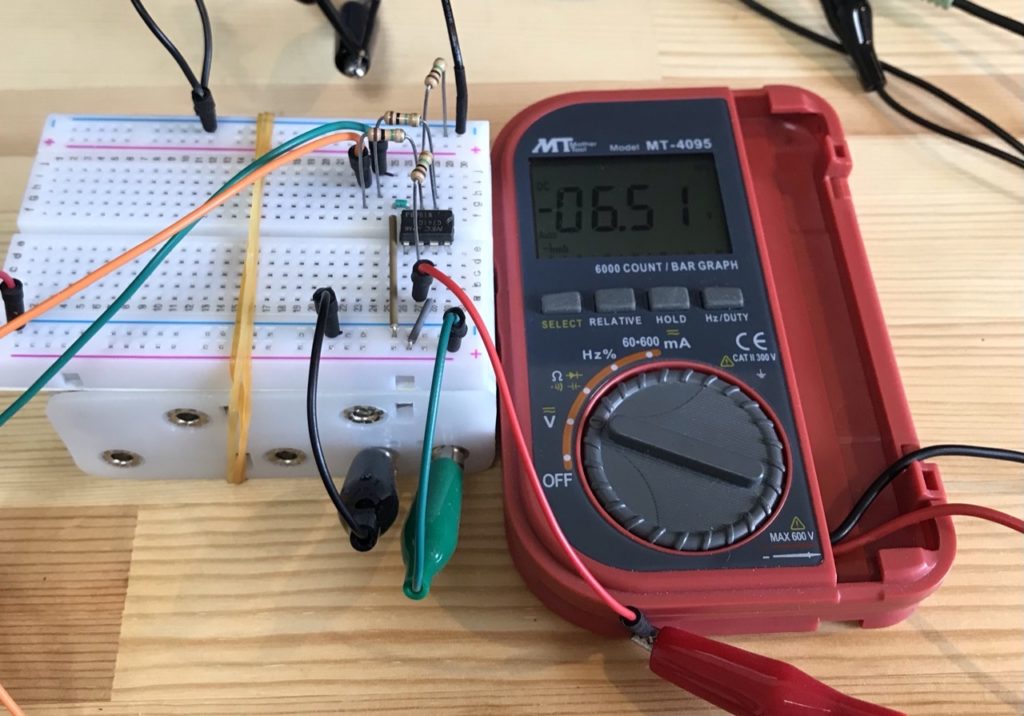

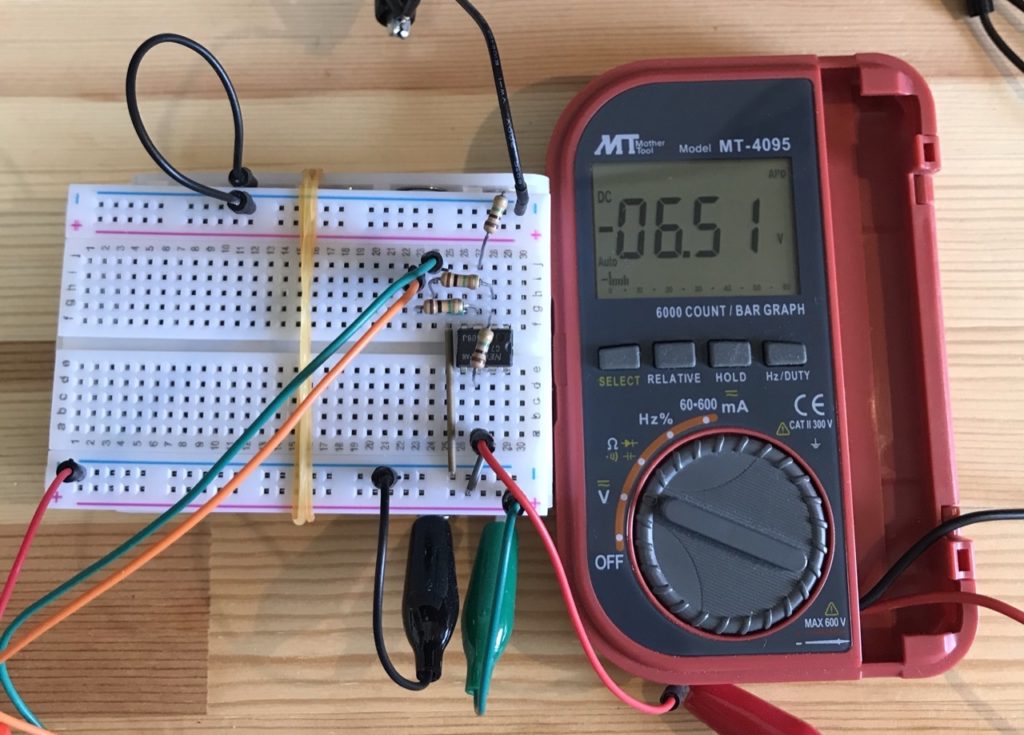

期待通り5本分のマイナス電圧が出ています。

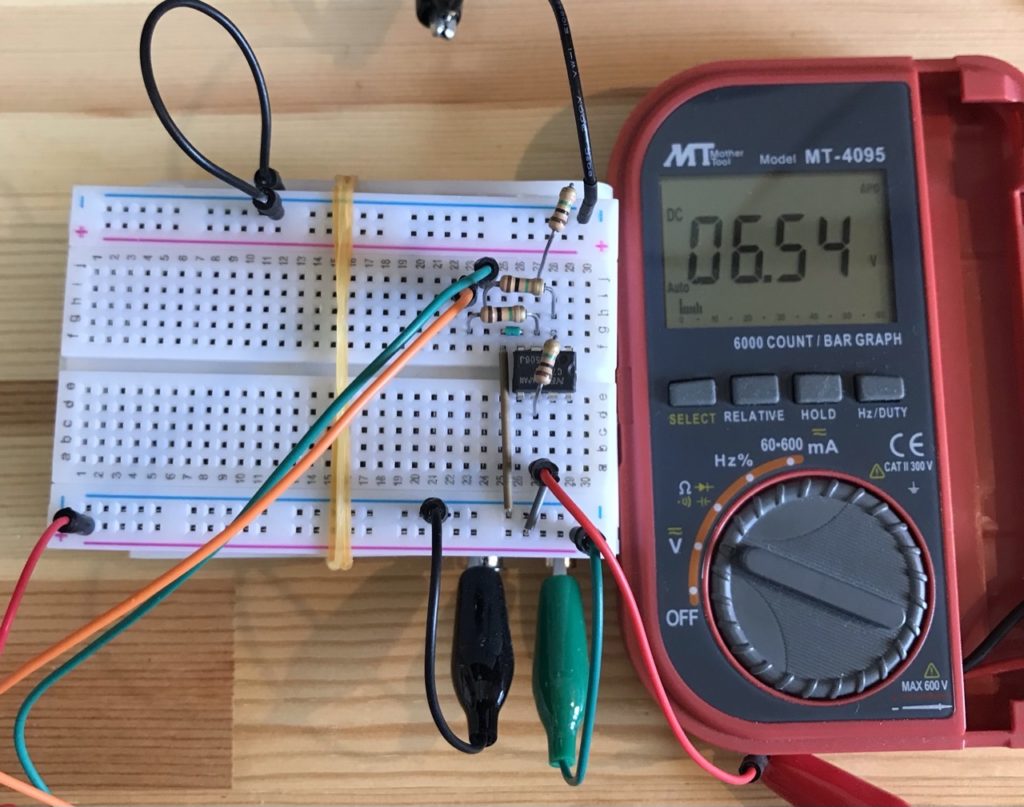

プラス側も5本分の電圧が出ています。

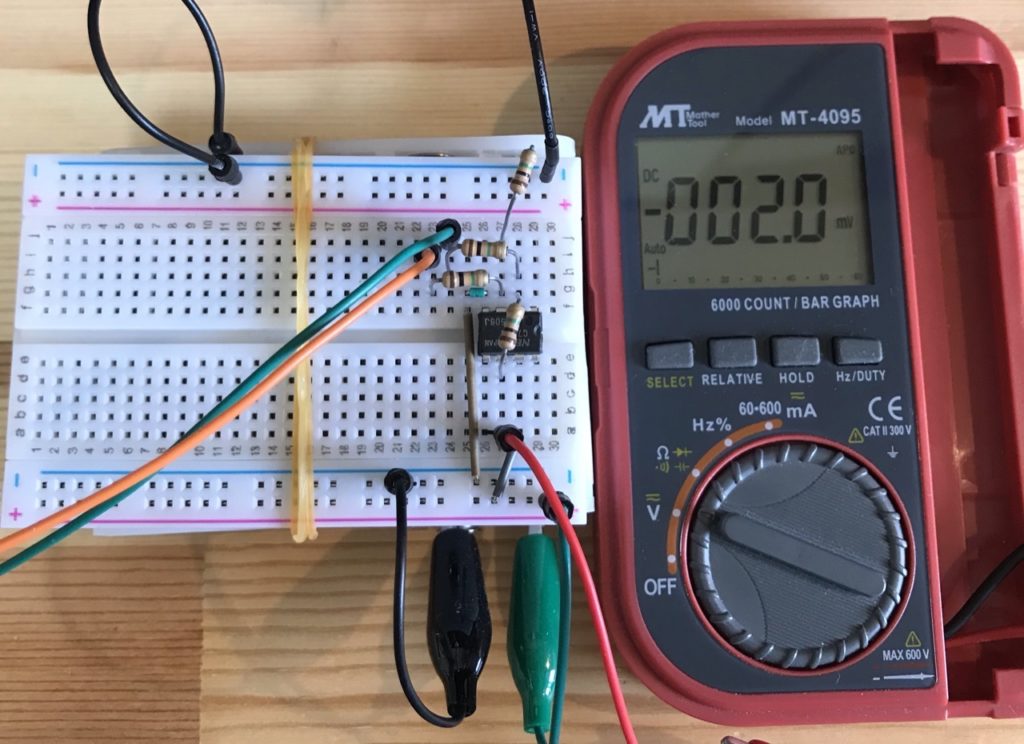

入力に電圧がかかっていない場合は出力も出ていないことが確認できます。

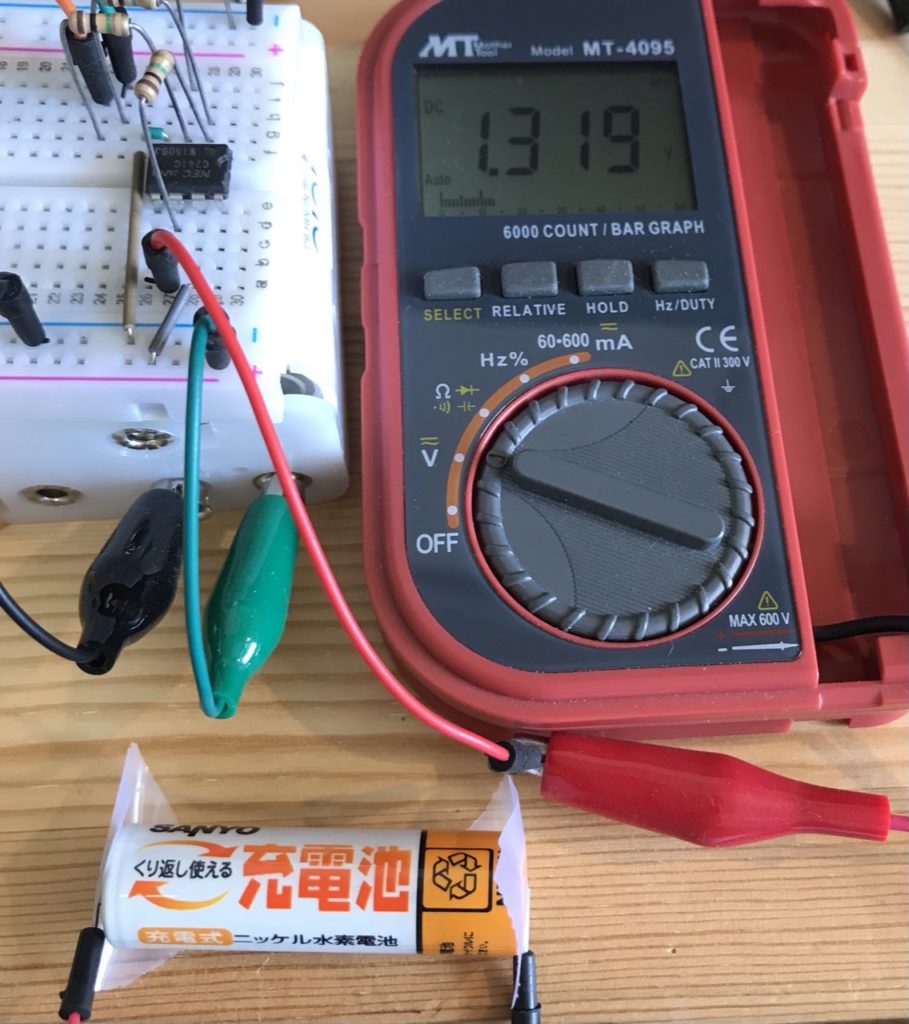

試しに入力側に電池を一つ繋いでみました。

出力側は反転していますが概ね同じような電圧が出ています。若干の誤差は後で調整します。

入力端子の抵抗値を測ります。2MΩもありますので大丈夫そうです。本当はインピーダンスを計りたいのですが器材が無いのでこれでよしとします。

Audacityで入力と出力を表示してみました。左が入力で右が出力です。少し増幅されています。

よく使う信号を入力し拡大した絵です。

出力側は波形が反転していますが十分に使えそうな結果になりました。

どのプラットフォームを採用すれば良いかはその時々で様々な見解に分かれますが常に念頭に置いておかなければならない観点をまとめます。

それぞれのプラットフォームはアプリを開発出来ると謳っていますが、どこまでネイティブ固有の機能を利用できるか承知した上で利用します。開発していく中で要件を実現できないことになっては大変です。無理してできたとしても予定外のコストが掛かってしまってはそのプロジェクトを成功には導けません。

OS自体がC/C++でできているのでネイティブ機能は全て利用できるはずですがそのアクセス方法が利用し易い形でまとまって公開されているわけでもないので難易度が高くまた、直接OSにアクセスするのでメンテナンスが大変です。高速処理が必要なOSに依存しないビジネスロジックをSDKなどの共通ライブラリとして利用するならば良いでしょう。

Binding to native code using dart:ffi にあるようにネイティブ機能を呼び出せます。

Connect to platform-specific APIs にあるようにネイティブ機能を呼び出せます。

アプリ開発の具体的な手順があまり載っていませんのでよくわかりません。OpenFL等の高機能なライブラリを利用して実装しC++に変換してからXcodeやAndroidStudioに取り込むのでしょうか?どの程度実用性があるかは試してみないと何とも言えないです。

昔のことですが随分とActionScriptにお世話になりました。だいぶ廃れてきましたがHaxeとOpenFLという形になって生き続けていると思います。実務に活かせるかどうかわかりませんが追い続けていきます。

2023.05.15

まだHaxeは生きているようです。

なので

ChatGPTに聞いてみた。

User

Haxeというアプリ開発環境は知っていますか。

ChatGPT

はい、Haxeはオープンソースのプログラミング言語およびアプリケーション開発フレームワークです。Haxeは、JavaScript、Flash、C++、Java、Python、PHP、C#、Objective-Cなど、さまざまなプラットフォームや言語で実行可能なコードを生成することができます。

Haxeは、静的型付けの言語であり、構造体やジェネリックなどの高度な機能を提供します。Haxeは、クロスプラットフォームの開発をサポートし、複数のターゲットに対してコンパイルできることが特徴です。例えば、Haxeで書かれたコードは、ウェブブラウザやモバイルデバイス上のネイティブアプリ、デスクトップアプリケーション、ゲームエンジン、およびその他のプラットフォーム上で実行できます。

Haxeには、豊富なライブラリやフレームワークが用意されており、それらを利用することで、開発者は簡単に高品質なアプリケーションを作成することができます。また、Haxeは、エディタやIDEのプラグインなど、豊富なツールセットを提供しており、効率的な開発が可能です。

Haxeは、広く利用されているプログラミング言語やフレームワークよりも新しいため、まだ一般的な知名度は高くありませんが、将来的には重要な開発環境の1つになる可能性があります。

今注目しているMultiplatform開発環境は、

C/C++

Flutter

KMM

です。それぞれ長所、短所があるので比較してみます。それとマイナーですが個人的な思い入れで

Haxe

も一緒に比較します。

C/C++

PCでもスマホでも組み込み用のマイクロコントローラーでも開発できます。Emscriptenを使えばWebアプリでも大丈夫です。古い言語なので広範囲に応用されており修得している人材の幅が広いです。

Flutter

ビューもコントローラーもモデルもDartで開発できます。FlutterもPCでもスマホでもアプリを開発できます。デザインを統一できるアプリ開発なら共通化のメリットを存分に受けられます。

KMM

デザインパターンでいうモデルを両モバイルOSで共通化しビューはそれぞれのIDEで作成するというコンセプトです。KMMはKotlinで作ったモデルをiOSでも使えます。OSごとの特徴を活かし且つ少しでも共通化したいアプリ開発に向いています。

Haxe

ActionScriptから発展したマルチプラットフォーム開発環境です。Flashの資産を使えるためアニメーションを多用するならばまだ選択肢になるのではないかと思います。

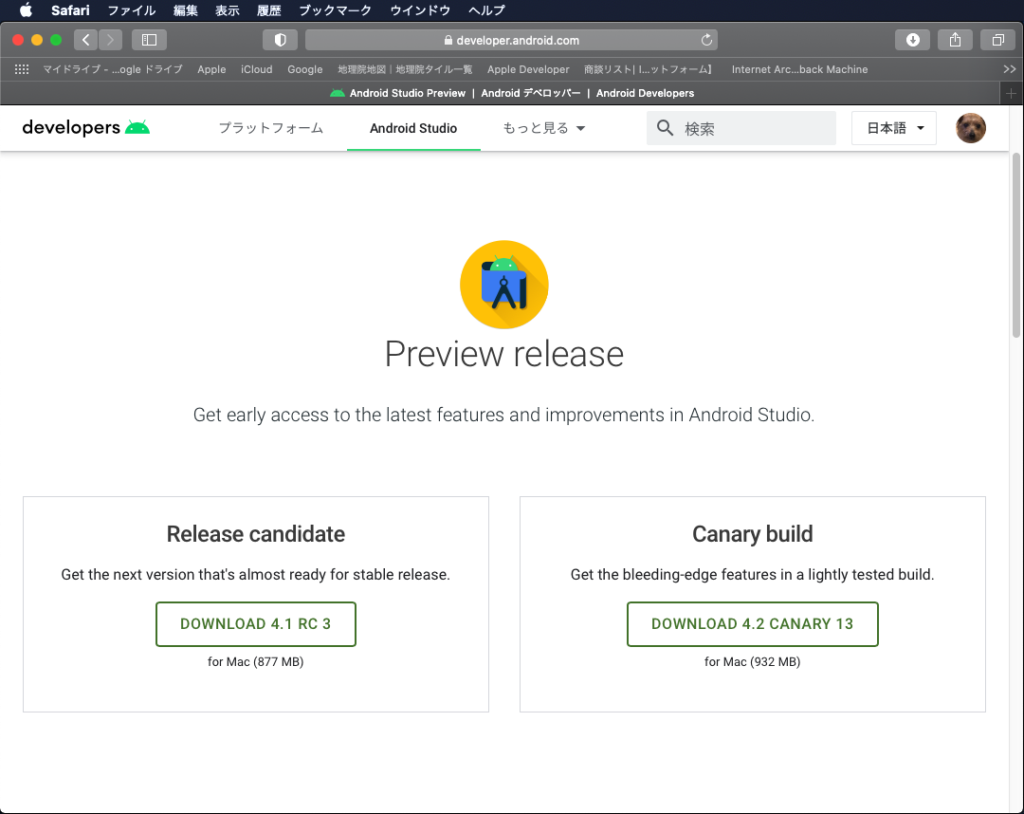

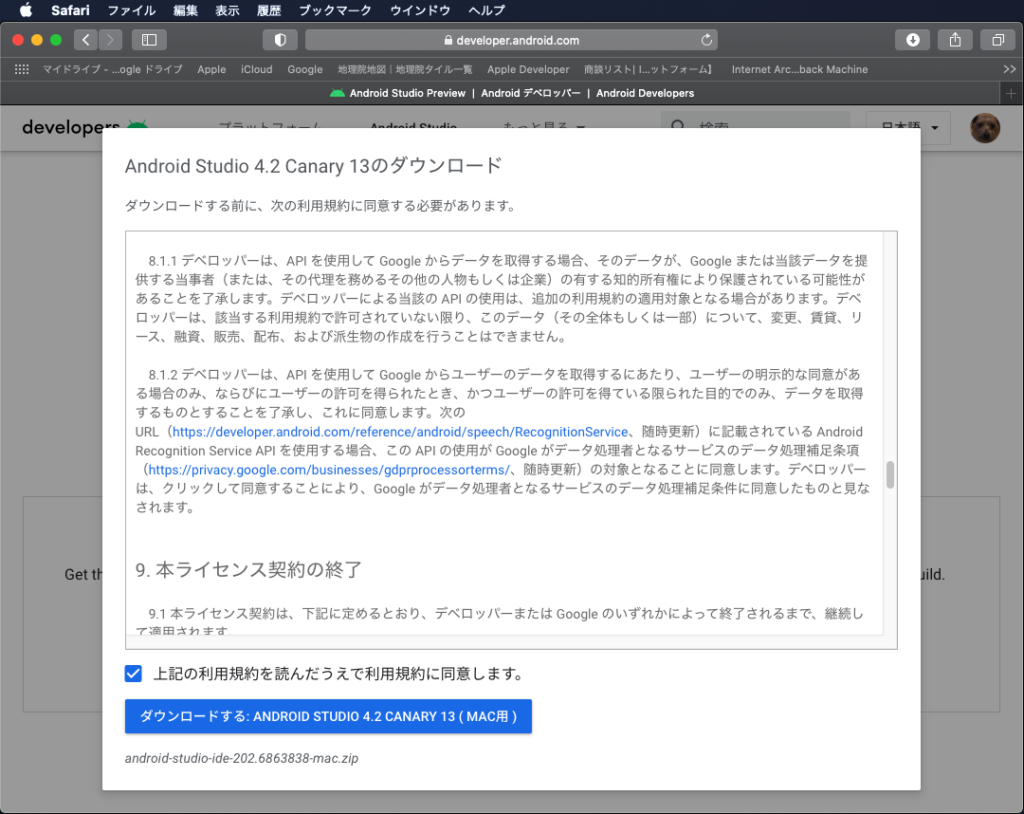

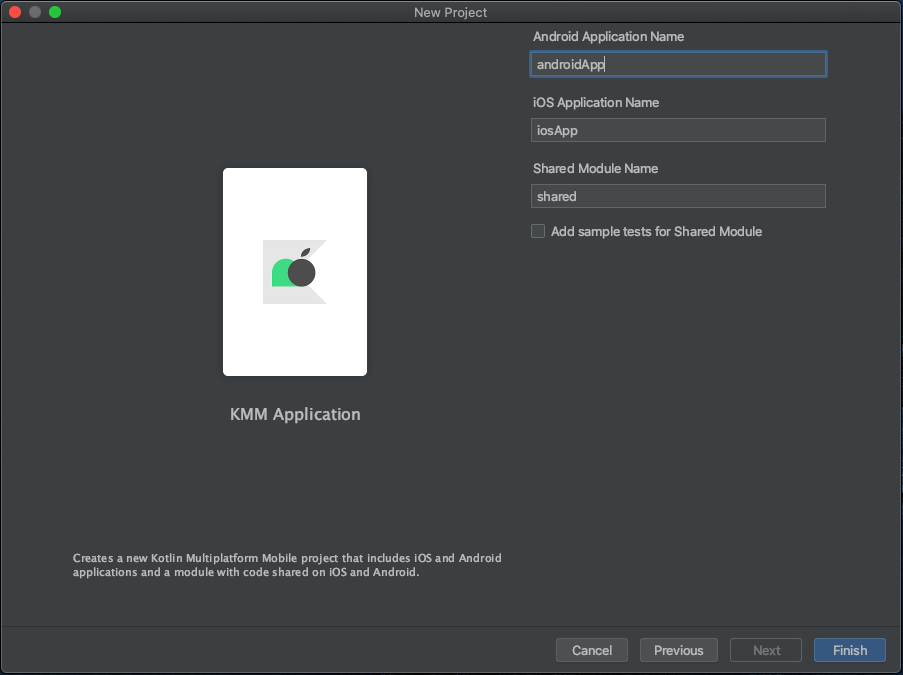

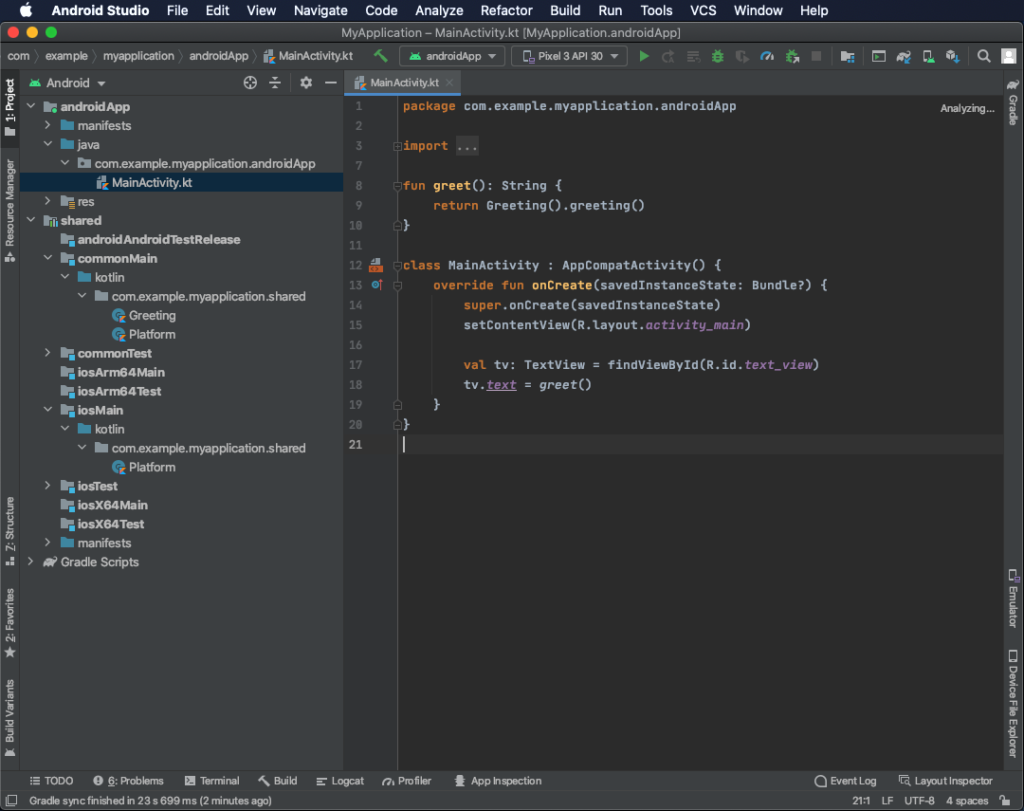

AndroidStudio + KotlinでiOSのアプリも開発できるのがKMMです。まだ正式リリースされていませんがベータ版でその実力を見ていきましょう。

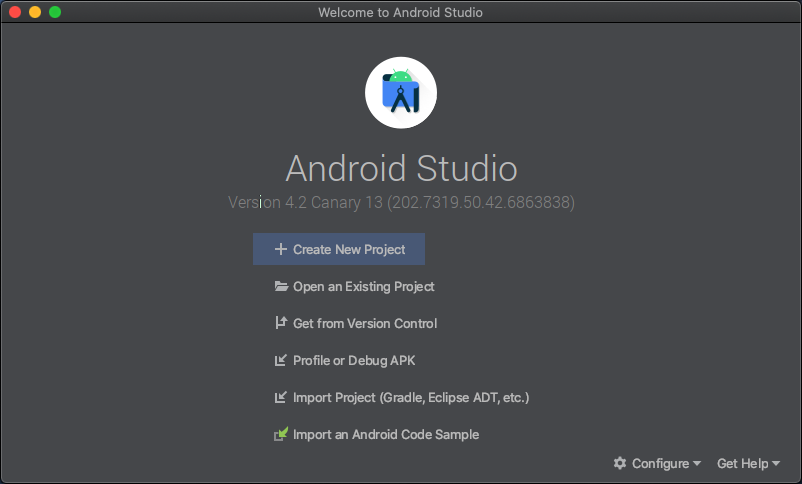

Android Studio Preview releaseをインストールします。

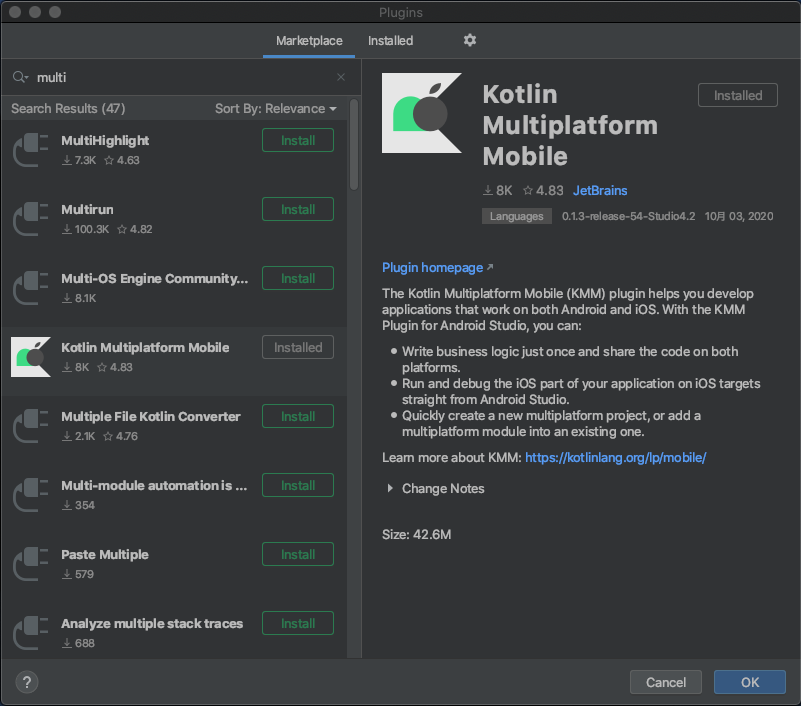

ConfigureでPluginをインストールします。

Kotlin Multiplatformをインストールします。

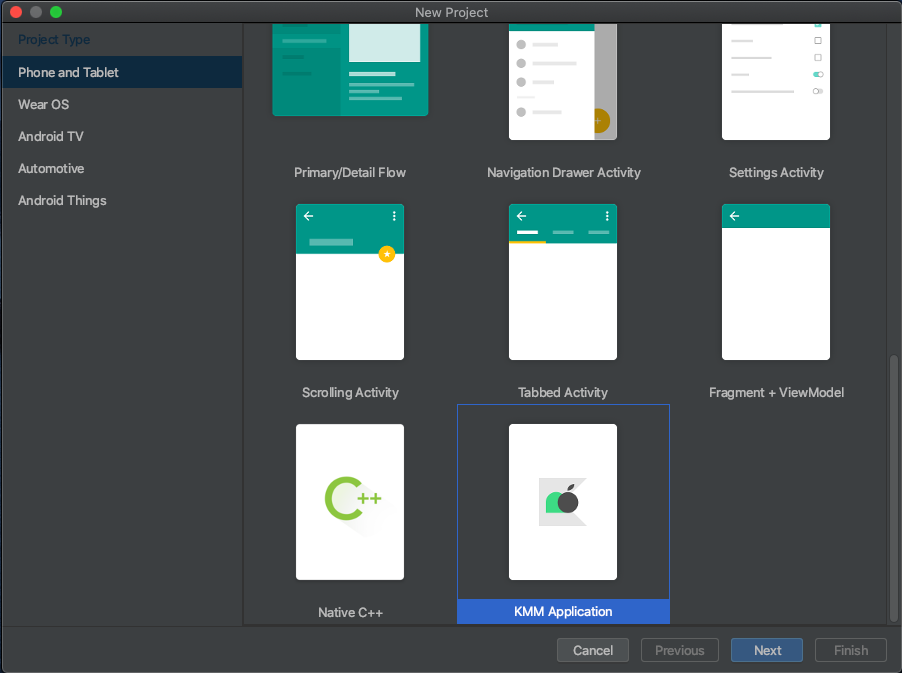

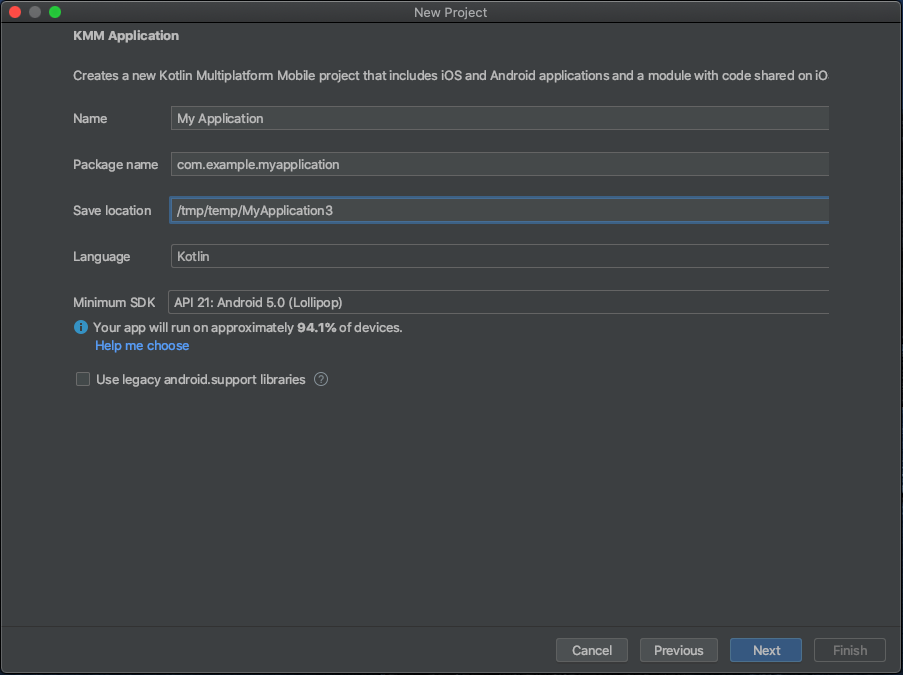

Projectを新規作成しKMM Applicationを選択します。

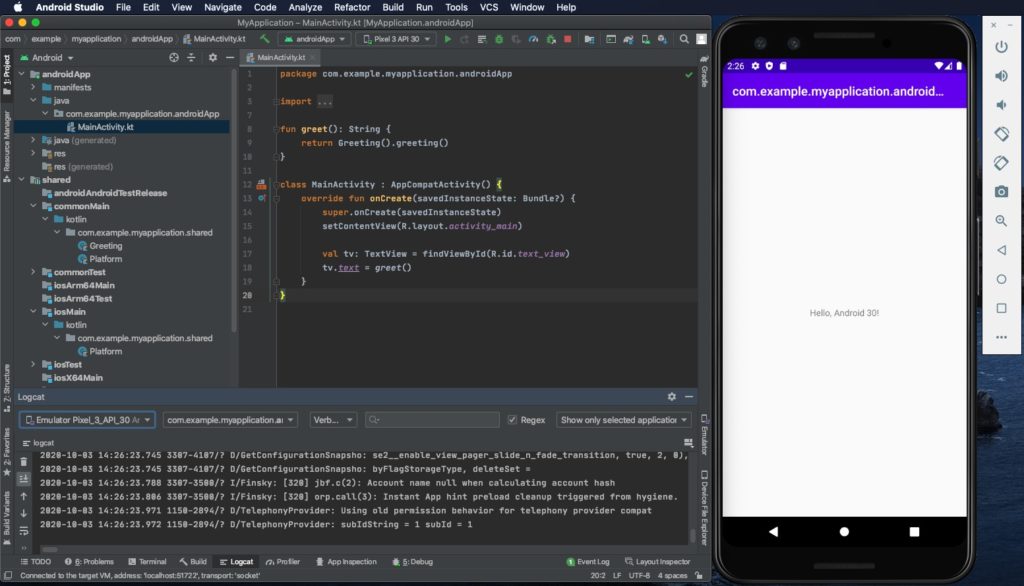

Androidアプリをデバック実行します。

Androidシュミレーターで無事に動きました。

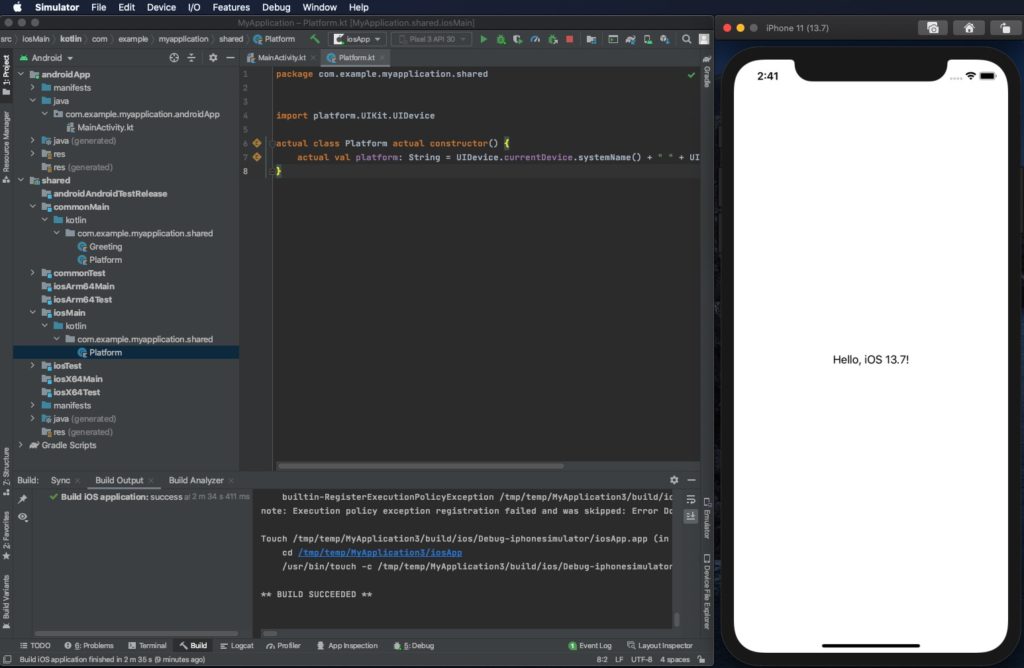

続いてiOSアプリをデバック実行します。

iOSシュミレーターで無事に動きました。

生物、および生物が営む生物的な意味合いをもつあらゆる過程はきわめて「多くの原子から成る」構造をもっていなければならない。そして、偶然的な「一原子による」出来事が過大な役割を演じないように保障されていなければならない。

は、誤っている。

遺伝物質に関するデルブリュックの一般的な描像から出てくる事柄とは、生きているものは、今日までに確立された「物理学の諸法則」を免れることはできないが、今までに知られていない「物理学の別の法則」を含んでいるらしい。

とあるが解らないけど何かが含まれているという構造は人工知能に必要だと思います。

周辺環境に合わせて安定化していくものを非生物、周辺に関わらず自身の状態を安定化しようとするものを生物であると理解しました。